Google составили свои пять законов робототехники

3837

2 минуты на чтение

Компании Google и OpenAI совместно с Калифорнийским университетом и Стэнфордским университетом сформулировали пять практических проблем, которые необходимо учитывать разработчикам искусственного интеллекта.

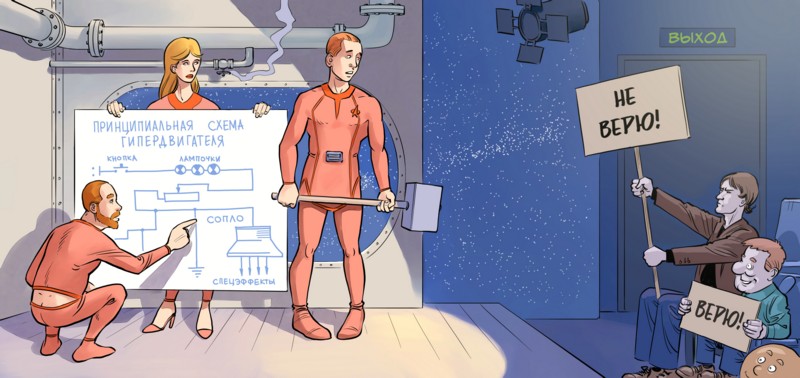

В своей статье авторы решили рассматривать не гипотетическое «восстание машин», о котором так любят говорить фантасты, а потенциальные опасности, связанные с самообучением машин.

Вот пять проблем, которые они сформулировали:

Исследователи предлагают несколько способов бороться с приведёнными проблемами: ввести человеческий надзор, использовать симуляции для обучения и ограничить пространство для деятельности роботов. Однако специалисты считают, что ни одно из существующих на сегодняшний день решений не является окончательным и всеобъемлющим.

- избегание нежелательных побочных эффектов (робот-уборщик может разбить базу, если это ускорит уборку комнаты);

- избегание жульничества (робот может попросту прикрыть мусор, а не убрать его);

- гибкая потребность в надзоре (если робот-уборщик может посоветоваться с человеком при выполнении той или иной задачи, то он не должен надоедать вопросами);

- безопасное обучение (уборщику не стоит перебирать всевозможные варианты, например, не стоит экспериментировать и протирать розетку мокрой тряпкой);

- устойчивость к смене деятельности (уборка в цехе металлообработки и химической лаборатории принципиально отличается).

Статьи

Джордж Мартин намекнул на фильм по Elden Ring

Для «Смуты» анонсировали большое дополнение про казака Киршу

Пока без даты релиза.

Слух: в TES 6 появятся морские сражения и строительство кораблей в духе Starfield

Игру могут показать в июле 2025-го.

Marvel заморозила сразу три супергеройских сериала

Официально шоу не получили зеленый свет от Marvel.

«Аватар» получит сиквел — про мага Земли

Всего будет 26 эпизодов

По «Хроникам Нарнии» могут снять восемь фильмов

Об этом обмолвился глава IMAX.

«Разделение» стало самым просматриваемым сериалом в Apple TV+

Шоу обогнало «Теда Лассо»

Джордж Мартин мог закончить цикл книг «Колесо времени» вместо Брэндона Сандерсона

Но выбор вдовы Роберта Джордана все-таки пал на Сандерсона, который на тот момент еще не был так популярен.

Первый тизер хоррора «Верни ее назад» от A24

Выйдет 30 мая

Сооснователь Riot надеется, что MMO по League of Legends выйдет раньше, чем люди окажутся на Марсе

Это его любимый проект

Показать ещё

Спецпроекты

Все спецпроекты

Все спецпроекты